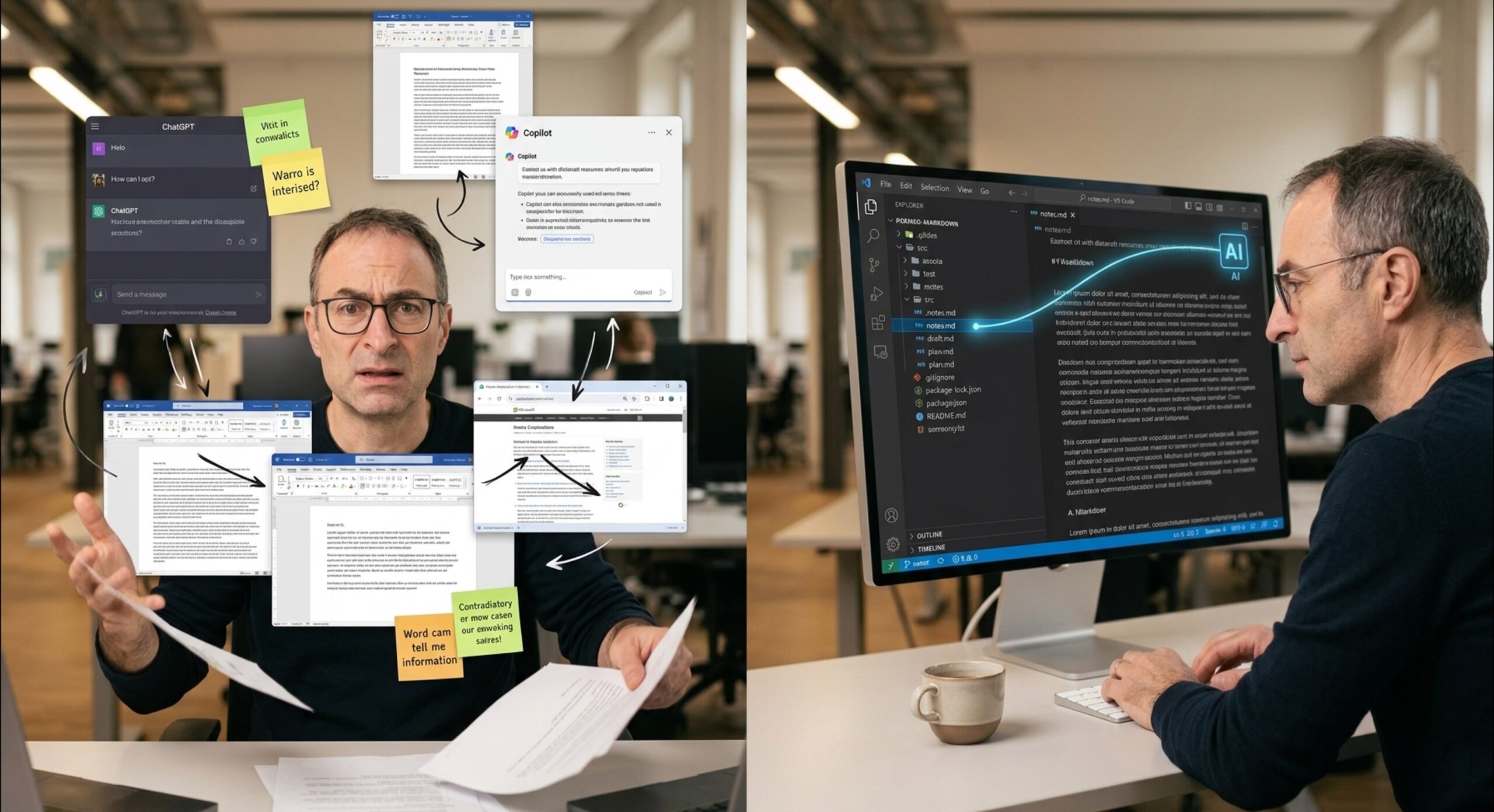

Du benutzt KI. Du bekommst gute Outputs. Und trotzdem fühlst du dich nach jedem Gespräch mit dem Modell so, als wärst du von vorne gestartet.

Das war mein Alltag über Monate. Und ich habe lange nicht verstanden, warum.

Die Ausgangssituation: Gute KI, der falsche Rahmen

Ich entwickle gerade ein B2B-SaaS-Produkt für agile Teams. Kein reines Code-Projekt, sondern von Anfang an ein Konzept, das ich mit Experteninterviews, Hypothesen und Community-Feedback iterativ weiterentwickle.

Mein Workflow sah so aus:

- Ich führe ein Interview mit einem potenziellen Nutzer.

- Ich fasse meine Beobachtungen in einem Dokument zusammen.

- Ich öffne ChatGPT oder M365 Copilot und beschreibe, was ich gelernt habe.

- Das Modell hilft mir, Schlussfolgerungen zu formulieren.

- Ich kopiere die Ergebnisse in mein Hypothesen-Dokument.

- Ich öffne das Konzept-Dokument und passe es manuell an.

- Ich merke, dass das Modell im nächsten Schritt wieder nicht weiß, was schon im Konzept steht.

- Ich starte mit Copy & Paste von vorne.

Das Problem war das Hin und Her zwischen Prompt, Kontext und Dokumenten. Ich war der manuelle Verbindungsknoten zwischen meinem Wissen und dem Modell.

Was M365 Copilot, ChatGPT und Notebooks nicht lösen

Ich habe mehrere Umgebungen ausprobiert und ihre Grenzen erlebt:

- M365 Copilot und Notebooks: Klammern ein einzelnes Dokument. Wenn mein Konzept auf fünf Dateien verteilt ist, muss ich manuell entscheiden, was ich dem Modell zeige. Das ist besser als nichts, aber es skaliert nicht.

- ChatGPT mit langen System-Prompts: Funktioniert für eine Session. Spätestens beim nächsten Gespräch beginnt die Zusammenfassung des vorherigen Stands. Fehler schleichen sich ein, Nuancen gehen verloren, ich überprüfe jedes Mal, ob der Kontext stimmt.

- M365 Copilot in OneNote, Confluence, Word: Sieht einzelne Dokumente, nicht das Gesamtbild. Ich kann nicht sagen: „Lies zuerst das Konzept, dann die Hypothesen, dann das Interview-Protokoll, und passe dann Punkt 2.3 an.“

Der Kern des Problems: Ich konnte den Kontext für meinen nächsten Prompt nicht präzise genug definieren. Ich war gefangen in der Frage, was das Modell gerade „weiß“ und was nicht.

Der Durchbruch: VS Code als Knowledge Hub

Ich nutze VS Code als meine primäre Entwicklungsumgebung. Irgendwann habe ich begonnen, meine Konzept-Dokumente dort abzulegen, erst aus Gewohnheit, dann mit Absicht.

Das Ergebnis hat mich überrascht.

GitHub Copilot liest den gesamten Workspace. Wenn ich ein Hypothesen-Dokument, ein Interview-Protokoll und das Kern-Konzept gleichzeitig geöffnet habe, hat Copilot Zugriff auf alle drei. Ich muss nicht zusammenfassen. Ich muss nicht kopieren. Ich beschreibe, was ich will, und the Modell handelt auf Basis dessen, was wirklich da ist.

Was das in der Praxis bedeutet: Ich habe heute folgende Dateien in einem Verzeichnis:

Konzept/

01_core_product.md — das Kernprodukt, Features, Positionierung

02_targetaudience_persona.md — Zielgruppe und Persona-Profile

Problem- und Lösungshypothesen.md — alle PH/LH mit aktuellem Validierungsstatus

03_marketing_memory.md — was funktioniert hat, was nicht

Interviews/ — ein Protokoll pro Interview

Linkedin-Posts/ — alle Posts mit Ergebnissen und MappingDas ist mein Produktgedächtnis. Und GitHub Copilot ist der erste Assistent, der dieses Gedächtnis vollständig lesen und gemeinsam mit mir weiterentwickeln kann.

Kontext als lebendiges Wissen

Ein Beispiel aus meiner Praxis, das mir erst im Nachhinein klar geworden ist:

Nach einem Gespräch mit einem Scrum Master hat sich mein Verständnis verändert. Eine Hypothese, die ich für bestätigt hielt, bekam eine Einschränkung. Eine andere, die ich fast aufgegeben hatte, wurde plötzlich interessanter. Ich habe pivotiert.

In früheren Workflows hätte ich das irgendwo notiert und später manuell in meine Dokumente eingearbeitet. Oder vergessen. Was in diesem Moment fehlte, war nicht die KI, sondern ein Ort, an dem dieses veränderte Verständnis sofort Teil des nächsten Denkschritts werden konnte.

Das ist, was ich mit „lebendigem Kontext“ meine: Wissen, das sich mit jedem Gespräch, jeder Entscheidung, jeder Erkenntnis verändert. Nicht ein Dokument, das irgendwann fertig ist. Und genau diese Dynamik ist der Punkt, an dem die meisten KI-Workflows scheitern. Weil mein eigenes Wissen weiterläuft und der KI davon nichts mitgeteilt wird.

Was das für POs und Führungskräfte bedeutet

Es gibt eine Annahme, die ich lange hatte und die sich als falsch herausgestellt hat: mehr Kontext führt zu besseren Ergebnissen.

In der Praxis ist das Gegenteil oft der Fall. Wenn ich dem Modell alles gebe, was ich habe, werden die Outputs diffus. Die KI verliert sich in Nuancen, die für den nächsten Schritt irrelevant sind. Was funktioniert, ist Auswahl: das Wissen, das für genau diesen Denkschritt relevant ist, nicht das gesamte Archiv.

Das ist eine Kompetenz, die ich erst entwickeln musste. Welche Hypothesen sind für dieses Gespräch relevant? Was darf ich dem Modell weglassen, ohne dass es einen blinden Fleck bekommt? Wann ist Kontext zu viel?

Diese Frage ist, wie mir aufgegangen ist, keine technische. Sie ist eine inhaltliche. Wer weiß, was er denkt, kann steuern, was die KI sieht. Wer selbst noch sucht, gibt oft zu viel weiter und bekommt zu wenig Richtung zurück.

Die andere Flughöhe: Was das im Team bedeutet

Alles, was ich hier beschreibe, bezieht sich auf meine individuelle Arbeit. Aber die eigentlich interessante Frage stellt sich eine Ebene höher.

Was geschieht, wenn nicht eine Person, sondern ein ganzes Team Kontext für KI verfügbar halten muss? Wenn Hypothesen von mehreren Personen gleichzeitig weiterentwickelt werden? Wenn ein PO seine Roadmap-Annahmen kennt, aber die Scrum Master die Prozessdaten haben, und das Modell von keinem der beiden das vollständige Bild sieht?

Das ist kein technisches Problem, das mit einem besseren Tool gelöst wird. Es ist eine Frage der geteilten Wissensorganisation. Wer entscheidet, was als Kontext gilt? Wer hält es aktuell? Und wie erkennt ein Team, dass sein gemeinsamer Kontext veraltet ist?

Ich habe darauf keine abgeschlossene Antwort. Aber ich beobachte, dass Teams, die KI produktiv nutzen, diese Fragen bewusst gestellt haben. Die anderen haben sie übersprungen und arbeiten jetzt mit gut klingenden Outputs auf Basis veralteter Annahmen.

Einschränkungen und ehrliche Einordnung

Dieser Workflow funktioniert besonders gut für konzeptionelle, iterative Arbeit mit vielen Dokumenten. Es gibt Grenzen:

- GitHub Copilot liest nicht unbegrenzt viel. Bei sehr großen Workspaces wählt Copilot aus, was es in den Kontext einbezieht. Du musst trotzdem mitdenken, was du öffnest und was nicht. Der Kontext-Puffer ist groß, aber nicht unendlich.

- Du brauchst eine Ordnerstruktur mit Prinzipien. Wenn deine Dateien unstrukturiert wachsen, verlierst du die Übersicht genau dann, wenn das Projekt größer wird. Eine ehrliche Benennung und eine klare Hierarchie sind Pflicht.

- Markdown ist kein All-inclusive-Format. Für Präsentationen, Tabellen mit komplexen Berechnungen oder Diagramme brauchst du andere Tools. VS Code ist der Hub, nicht die einzige Umgebung.

- Das Modell hat keinen Langzeit-Kontext über Sessions hinweg. Was gestern im Chat besprochen wurde, ist heute weg. Deine Dateien sind dein Gedächtnis, nicht der Chat-Verlauf. Das ist kein Bug, das ist der Grund, warum die Dateien so wichtig sind.

Fazit

Das Problem war, dass mein Wissen weitergelaufen ist und das Modell davon nichts wusste.

Ich habe keine Lösung gefunden, die das ein für alle Mal behebt. Ich habe eine Umgebung gefunden, in der das Nachführen von Kontext weniger Aufwand kostet als anderswo. Das ist nicht dasselbe.

Was mich mehr beschäftigt als die technische Einrichtung ist die Frage, die dahinter liegt: Wie viel meines eigenen Wissens ist eigentlich strukturiert genug, um es einer KI zugänglich zu machen? Und was sagt es über mein Denken, wenn ich merke, dass ich den Kontext nicht gut beschreiben kann?

Vielleicht ist das der eigentliche Wert dieser Arbeitsweise. Nicht dass die KI besser wird, sondern dass ich klarer werde über das, was ich weiß, was ich noch nicht weiß, und was ich gerade herausfinden will.

Wie gehst du damit um, wenn dein eigenes Wissen schneller weiterläuft als dein KI-Kontext?